Generative KI und ChatGPT – müssen wir nicht mehr (selbst) denken?

München, 22. März 2023

Seit der Veröffentlichung von ChatGPT durch OpenAI im November 2022 haben schon viele Neugierige mit dieser Errungenschaft herumgespielt. Sei es, um sich einen Aufsatz schreiben zu lassen oder einen Fitnessplan zu erstellen. Mit seinen ganz persönlichen Versuchen, das Programm zu nutzen, eröffnete acatech Präsident Jan Wörner die acatech am Dienstag-Ausgabe vom 14. März und zeigte die erstaunlich überzeugenden Ergebnisse, wenn ChatGPT beschreibt, was acatech ist. Ein von ChatGPT erzeugtes Gedicht über acatech brachte das Publikum zum Schmunzeln. Als es jedoch um die Frage nach dem aktuellen acatech Präsidenten ging, lag die Antwort der KI weit weg von der Wahrheit. Das zeigt sehr deutlich, dass in ChatGPT großes Potenzial steckt, die Ergebnisse aber kritisch hinterfragt werden müssen.

Volker Tresp, Professor für Maschinelles Lernen in der Informatik der Ludwig-Maximilians-Universität München, und Mitglied der Plattform Lernende Systeme (PLS), legte die technologischen Grundlagen für das Verständnis von generativer KI, insbesondere bezogen auf Sprachmodelle wie ChatGPT. Die Grundlage ist das Sprachmodell GPT-3 (Generative Pre-Trained Transformer), hierbei handelt es sich um einen KI-Algorithmus, der gelernt hat, das nächste Wort vorherzusagen, basierend auf den vorangegangenen Wörtern und Sätzen. Das Neue an ChatGPT im Vergleich zu seinen Vorgängern ist der Umstand, dass der Lernprozess auch Stufen des überwachten Lernens (supervised learning), eine Bewertungsfunktion (reward model) und sogenanntes bestärkendes Lernen (reinforcement learning) enthält. Dieses Vorgehen, basierend auf Wahrscheinlichkeiten, zeigt auch die aktuellen Grenzen der Technologie auf: Es liefert stets die wahrscheinlichste Antwort (auch wenn diese falsch ist), es erfindet bisweilen Inhalte oder Quellen („halluziniert“) und ist auf dem Wissensstand von 2021. Das heißt, es findet kein Online-Learning des Modells statt. Abschließend machte Volker Tresp deutlich, dass ChatGPT einen massiven Einfluss auf die Entwicklungen der nächsten Jahre haben werde und sich als Gamechanger herauskristallisiere.

Impulsvortrag von Volker Tresp zu den technischen Grundlagen großer Sprachmodelle, eingeführt durch die Moderatorin Birgit Obermeier (Dauer 15 Minuten 27 Sekunden)

Die aktuelle öffentliche Diskussion zu ChatGPT wird häufig von einer Diskussion um ein Verbot der Technologie begleitet, da nun auch Hausarbeiten und Prüfungen „einfach vorgeschrieben werden könnten“. An diesem Punkt hakte PLS-Mitglied Ute Schmid, Inhaberin des Lehrstuhls für Kognitive Systeme an der Otto-Friedrich-Universität Bamberg, ein. Ihrer Meinung nach mache es wenig Sinn, technologische Neuerungen zu verbieten. Vielmehr sei es wichtig, Technologien zu nutzen, um menschliche Kompetenzen zu erweitern und zu fördern. Dennoch wies Ute Schmid zunächst auch auf die Probleme für die Bildung hin, die mit ChatGPT einhergehen. Resultate werden, anders als auf Websites, ohne Kontext geliefert, so fällt es schwer einzuschätzen, wie glaubwürdig und zuverlässig die Ergebnisse sind. In vielen Bereichen seien 90 Prozent der verfügbaren Inhalte eher als weniger seriös zu bewerten, sagte Ute Schmid. Auch sieht sie die Gefahr, dass sich Fähigkeiten der Nutzerinnen und Nutzer zurückbilden, die für das Strukturieren komplexer Sachverhalte erforderlich seien. Als Chance wertet Ute Schmid die mögliche Entlastung Lernender und Lehrender. Durch den Wegfall repetitiver Aufgaben gewännen Lernende mehr Zeit und Freiräume, um ein tieferes Verständnis zu entwickeln und in komplexen Problemlösungen besser geschult zu werden. Optimalerweise führe dies auch zu einer Entlastung von Lehrkräften, die diese Zeit in die Interaktion mit den Schulklassen investieren könnten – angesichts des zunehmenden Mangels an Lehrpersonal ein wichtiger Beitrag. Abschließend betonte Ute Schmid, wie wichtig es ihr sei, die Diskussion über ChatGPT zu nutzen, um Bildung neu zu denken. Dafür sei es durch die hohe Verfügbarkeit digitaler Inhalte längst Zeit: eigenständiges Denken, kritisches Hinterfragen und Transfer seien die entscheidenden Kompetenzen.

Vortrag von Ute Schmid zu den Auswirkungen von KI-Anwendungen wie ChatGPT auf Bildung und Lernen, eingeführt durch die Moderatorin Birgit Obermeier (Dauer 13 Minuten 44 Sekunden)

Auch im betrieblichen Umfeld sind große Veränderungen zu erwarten, hierzu gab Johannes Hoffart, CTO der AI Unit bei SAP SE, einen Überblick über potenzielle Anwendungen in Unternehmen. Er sei selbst noch immer sehr begeistert und überrascht davon, wie erfolgreich das Kontext-Verständnis von ChatGPT funktioniere, dennoch könne von „nicht mehr selbst denken“ nicht die Rede sein. Vielmehr sei es ein Werkzeug, das zu nutzen sei. Generative KI könne in Geschäftsanwendungen, wie beispielsweise in digitalen Assistenten, genutzt werden. So ließen sich verstreut vorliegende Informationen gezielt und in einer Geschwindigkeit zusammentragen, wie es bisher nicht möglich war. Auch können strukturierte Dokumente gezielt automatisiert ausgewertet werden, ohne umfangreiche Dokumente einzeln durchsuchen zu müssen. Die größte Disruption sah Johannes Hoffart jedoch für das Generieren von Programmcode. Bereits heute funktioniere es sehr gut, Code nach Anweisung zu erstellen und diesen über Prüfverfahren zu verifizieren. Perspektivisch werde wohl kaum noch originärer Code von Menschen erstellt werden, vielmehr könne der Mensch in Zukunft komplexere Software-Anforderungen umsetzen, wie zum Beispiel die Verbesserung der Interaktion von verschiedenen Betreibersystemen durch automatisiertes Coding. Der Mensch prüft anschließend die gewonnene Interoperabilität. Generative KI solle den Menschen vor dem Rechner unterstützen.

Vortrag von Johannes Hoffart zur Implementierung von ChatGPT in Softwareanwendungen, eingeführt durch die Moderatorin Birgit Obermeier (Dauer 10 Minuten 55 Sekunden)

In der abschließenden Diskussion wurden einige Punkte aus den Impulsvorträgen wieder aufgegriffen. Einerseits beschäftige die Frage, wie generierte Inhalte zuverlässig als solche erkannt werden könnten. Hier sahen Volker Tresp und Ute Schmid die Möglichkeit einer technischen Lösung zur Erkennung solcher Texte, verwiesen aber gleichzeitig auf die dazu dringend notwendige Forschung, da Online-Learning mit dem Risiko der Zunahme von Fake-News einhergehe. Auch die Frage nach dem Umgang mit der Technikfolgenabschätzung beschäftigte einige der Gäste. Aktuell sei die Technologie allen Menschen zur Verfügung gestellt worden, ohne die Auswirkung auf den Menschen zu prüfen. Hier machte Ute Schmid wiederholt deutlich, dass das Zentrale im Umgang mit den Technologien sei, die Menschen zu fördern, damit entsprechende Kompetenzen entwickelt werden. Oft werde auch das eigenständige Verstehen von ChatGPT in Frage gestellt, jedoch zeigte Johannes Hoffart auf, dass zumindest bezogen auf Programmcode bereits von Verstehen gesprochen werden könne.

Fazit Jan Wörner: Derzeit sehe er ChatGPT als hilfreiches Werkzeug für „lockere“ Ideen und witzige Ansätze. Für ernsthafte Recherchen riet er, momentan noch auf verifizierte Quellen zurückzugreifen.

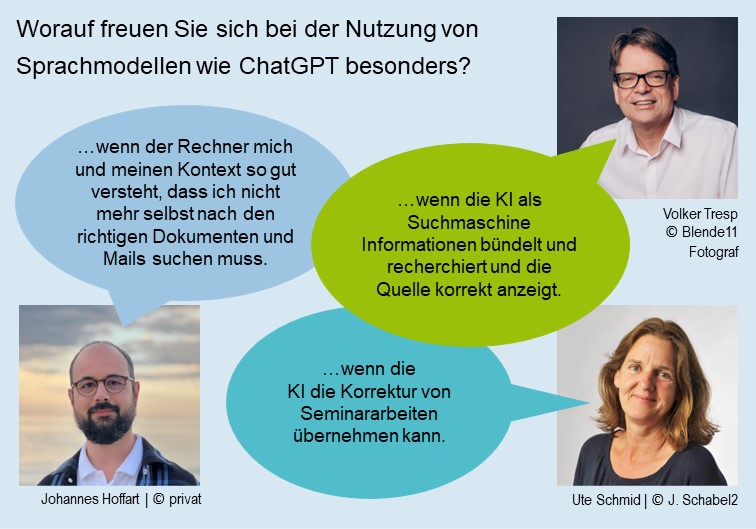

In der Abschlussrunde fragte Moderatorin Birgit Obermeier, Geschäftsstelle PLS, nach konkreten Anwendungsfällen, auf die sich die Panelisten bei der Nutzung von Sprachmodellen wie ChatGPT besonders freuen.